JAKARTA, incabroadband.co.id – Bandwidth yang besar sering dianggap sebagai satu-satunya faktor yang menentukan kualitas koneksi internet. Kenyataannya, banyak orang dengan koneksi 100 Mbps masih mengalami lag saat bermain game online, putus-putus saat video call, atau aplikasi web yang terasa lambat meski loading bar sudah penuh. Pelakunya sering bukan bandwidth yang kurang — melainkan network latency yang tinggi.

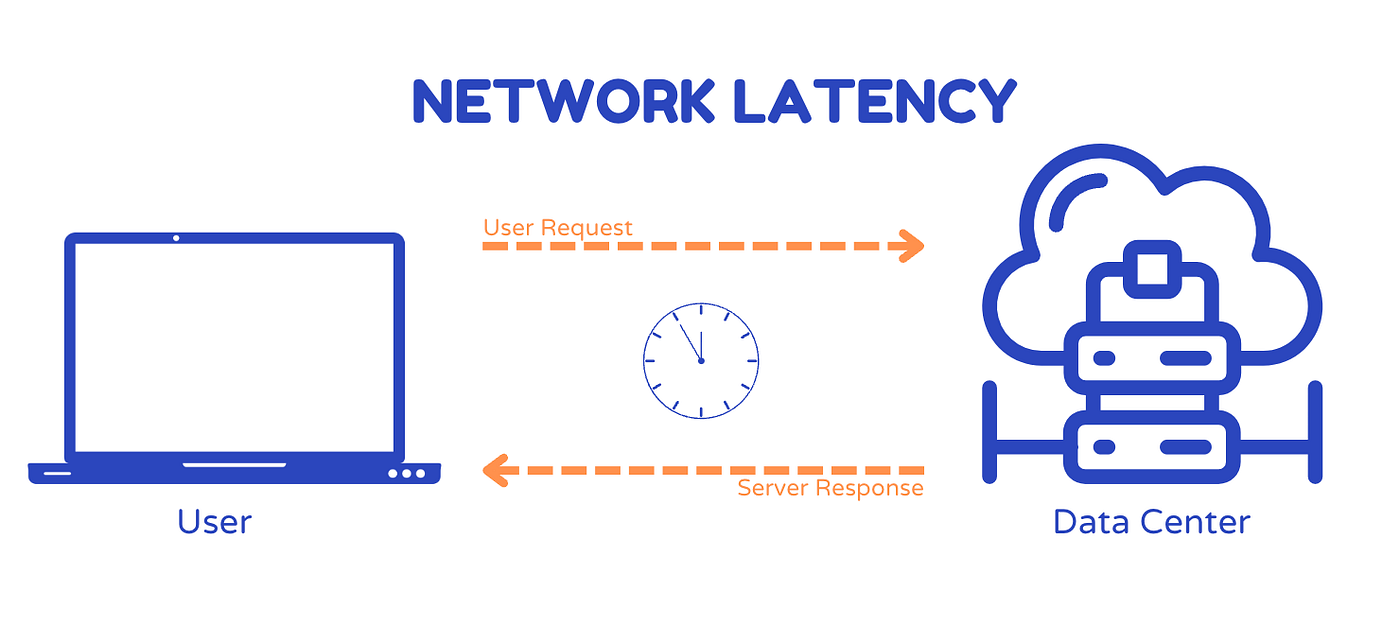

Network latency adalah ukuran waktu yang dibutuhkan data untuk melakukan perjalanan dari satu titik ke titik lain dalam jaringan. Memahami network latency sangat penting untuk mengoptimalkan performa aplikasi. Biasanya diukur dalam milidetik (ms) dan paling sering direpresentasikan sebagai Round Trip Time (RTT) — waktu yang dibutuhkan paket data untuk pergi ke tujuan dan kembali ke pengirim. Sementara bandwidth menentukan berapa banyak data yang bisa dikirim, latensi menentukan seberapa cepat respons pertama bisa diterima — dan perbedaan antara keduanya sangat menentukan pengalaman pengguna dalam berbagai jenis aplikasi.

Penyebab Utama Network Latency

Latensi jaringan bukan disebabkan oleh satu faktor tunggal. Ada beberapa sumber Network Latency yang bekerja secara kumulatif:

- Propagation delay: Waktu yang dibutuhkan sinyal untuk melintasi jarak fisik antar dua titik. Cahaya dalam fiber optik merambat sekitar 200.000 km per detik. Untuk koneksi ke server luar negeri, propagation delay saja sudah mencapai 30-150 ms.

- Processing delay: Waktu yang dibutuhkan router, switch, dan perangkat jaringan lainnya untuk membaca header paket, membuat keputusan routing, dan meneruskan paket ke antarmuka yang tepat. Setiap hop (lompatan) antar perangkat jaringan menambah beberapa mikrodetik.

- Queuing delay: Saat trafik jaringan padat, paket data mengantre di buffer router sebelum dikirimkan. Oleh karena itu, inilah penyebab utama latensi yang berfluktuasi (jitter) pada koneksi residensial saat jam sibuk.

- Transmission delay: Waktu yang dibutuhkan untuk mengirimkan seluruh paket data ke link jaringan. Bergantung pada ukuran paket dan kecepatan link. Pada koneksi cepat modern, faktor ini sangat kecil.

- Last mile latency: Koneksi terakhir antara jaringan operator dan perangkat pengguna sering menjadi bottleneck. Koneksi fiber optik memiliki last mile latency paling rendah, sementara koneksi 4G dan satelit tradisional memiliki latensi yang jauh lebih tinggi.

Dampak Latensi pada Berbagai Jenis Aplikasi

Latensi memengaruhi aplikasi secara sangat berbeda tergantung pada sifat komunikasinya:

Aplikasi yang sangat sensitif terhadap Network Latency:

- Online gaming: Setiap milidetik menentukan pengalaman. Latensi di atas 50ms sudah terasa lag. Di atas 100ms membuat pengalaman bermain game kompetitif menjadi sangat tidak nyaman.

- VoIP dan video conference: Latensi di atas 150ms mulai menciptakan efek “echo” dan percakapan yang tidak natural. Di atas 300ms membuat komunikasi terasa seperti walkie-talkie.

- Algorithmic trading: Di pasar keuangan, latensi diukur dalam mikro dan nanosecond. Perbedaan 1 milidetik bisa berarti keuntungan atau kerugian jutaan dolar.

Aplikasi yang kurang sensitif terhadap Network Latency:

- File download dan upload: Yang penting adalah throughput (bandwidth efektif), bukan latensi.

- Email: Pengguna tidak merasakan perbedaan antara latensi 10ms dan 200ms untuk pengiriman email.

- Streaming video: Buffer beberapa detik di awal mengkompensasi variasi latensi — yang lebih penting adalah konsistensi dan throughput.

Cara Mengukur Network Latency

Beberapa metode standar untuk mengukur latensi:

- Ping: Perintah paling dasar untuk mengukur RTT ke host tertentu.

ping google.comakan menampilkan latensi rata-rata ke server Google. - Traceroute / Tracert: Menampilkan latensi di setiap hop dalam jalur antara pengirim dan tujuan — sangat berguna untuk mengidentifikasi di mana latensi tinggi terjadi.

- iPerf3: Tool pengukuran jaringan yang lebih canggih untuk mengukur throughput dan latensi secara bersamaan.

- Platform monitoring: Layanan seperti Pingdom, UptimeRobot, atau Datadog memantau latensi ke server secara berkelanjutan dari berbagai lokasi geografis.

Strategi Mengurangi Network Latency

Sejumlah pendekatan teknis dan infrastruktur bisa mengurangi Network Latency secara signifikan:

- Content Delivery Network (CDN): Mendistribusikan konten ke server yang tersebar di berbagai lokasi. Pengguna dilayani dari server terdekat sehingga propagation delay berkurang drastis. Selain itu, CDN terkemuka seperti Cloudflare dan Akamai bisa memangkas network latency hingga 60-80 persen untuk pengguna yang jauh dari server asal.

- Edge computing: Memindahkan pemrosesan komputasi mendekati pengguna — bukan di data center terpusat — untuk meminimalkan jarak yang harus ditempuh data.

- Optimasi routing: Menggunakan protokol routing yang lebih cerdas dan jalur jaringan yang lebih pendek antara dua titik.

- TCP/UDP optimasi: Selain itu, penggunaan protokol QUIC yang dikembangkan Google mengurangi overhead handshake yang menambah latensi pada koneksi TCP tradisional.

- Pemilihan ISP dan data center: Memilih provider yang memiliki peering langsung dengan jaringan tujuan mengurangi jumlah hop yang harus dilalui.

Kesimpulan Network Latency

Network latency adalah dimensi kualitas jaringan yang sama pentingnya — bahkan sering lebih penting — dibandingkan bandwidth untuk sebagian besar penggunaan internet modern. Memahami sumber-sumber latensi, dampaknya pada berbagai jenis aplikasi, dan strategi untuk menguranginya adalah pengetahuan fundamental bagi siapa pun yang bekerja di bidang infrastruktur jaringan, pengembangan aplikasi, atau yang sekadar ingin mengoptimalkan pengalaman internet sehari-harinya.

Eksplorasi lebih dalam Tentang topik: Teknologi

Cobain Baca Artikel Lainnya Seperti: Smart Washing Machine: Lebih dari Sekadar Mesin yang Mencuci PakaianTags: CDN, Jitter, lag internet, latensi jaringan, network latency, optimasi jaringan, performa jaringan, ping, propagation delay, RTT